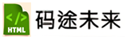

controlnet-canny, controlnet-depth 场景介绍

在图像到视频(Image-to-Video, I2V)和图像生成(Text-to-Image, T2I)领域,ControlNet-Canny 和 ControlNet-Depth 都是非常流行的控制模型,但使用场景略有不同,导致“用的多”取决于具体任务:

1️⃣ ControlNet-Canny

输入类型:边缘检测图像(Canny Edge)

特点:

强调轮廓和形状结构

可以精确控制生成物体的轮廓

典型应用:

动画和漫画风格生成(轮廓清晰)

对物体结构要求高的图像生成

I2V(图像到视频)场景中,控制动作或形态的变化

使用频率:在创意生成、动画、漫画风格作品中非常常见,因为它对结构控制精度高。

2️⃣ ControlNet-Depth

输入类型:深度图(Depth Map)

特点:

提供空间感、远近关系

对场景布局、透视、3D感很有帮助

典型应用:

生成具有真实透视和空间感的场景

复杂环境、建筑、室内场景生成

I2V 生成中,保持场景一致性

使用频率:在需要空间深度感的场景中使用多,尤其是室内、城市、3D感场景生成。

🔹 总结

更“普遍”用的:Canny 更常用于创意生成和视频动画,因为几乎每种图像都有明显边缘可以利用,用户更容易上手。

专业场景更常用:Depth 在需要真实空间感和复杂场景布局时用得更多。

简单记忆:

Canny → 轮廓

Depth → 空间/透视

上篇:

AI推理: 引导尺度, 采样步数, 采样偏移

下篇:

2025年AI大模型六大行业风口

1 10种最流行的卡通风格图像生成提示语 2 AI新玩法,制作历史大事件视频,涨粉20w,获赞220w 3 2026年人工智能领域,这些岗位急需大量人才 4 2026 年 AI 创业全景指南:给渴望借 AI 逐梦的人! 5 人工智能 AI 在电商全链条的12个主要应用场景 6 信息差搬砖:用AI把小红书火帖变“付费文档”,日入500+ 7 地理空间AI应用:YOLO vs. SAM 8 AI应用快速原型开发:FastAPI + htmx ——无需React,为了快 9 剖析Mini-SGLang,打开LLM推理引擎的黑盒世界 10 快到2026啦 必须掌握的AI智能体全栈技术! 11 2025年AI大模型六大行业风口 12 vLLM + FastAPI:一个高并发、低延迟的Qwen-7B量化服务搭建实录...