📌 工具简介

ZO2 (Zeroth-Order Offloading) 是一种创新的 零阶优化(ZO)+ 离载(Offloading) 技术框架,使大规模语言模型(LLM) 的 全参数微调(Full Fine-Tuning) 在低显存环境下成为可能。例如,它可以在仅 18GB 显存的 GPU 上微调 OPT-175B,极大降低硬件门槛。

✨ 主要特点

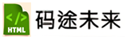

✅ 零阶 CPU 离载(ZO CPU Offloading):减少 GPU 内存占用,优化数据传输,提高训练效率。

✅ 动态调度(Dynamic Scheduling):智能优化计算与通信的重叠,提高 GPU 利用率,避免训练延迟。

✅ 超大规模模型支持(Very Large Model Capability):可在单卡 18GB GPU 运行 175B 级别的大模型微调。

✅ 高效性验证(Empirical Validation):实验证明 ZO2 在不影响时间成本和精度的前提下,高效完成超大模型训练。

🎯 适用场景

🔍 低显存环境下的 LLM 训练:解决高性能计算资源受限问题,让个人开发者或小型实验室也能参与大模型训练。

📉 优化计算资源使用:减少 GPU 需求,降低企业或研究机构的计算成本。

🤖 大模型微调(Full Fine-Tuning):适用于需要全参数微调的应用,如自然语言处理(NLP)、生成式 AI、语义搜索等。

⚡ 轻量级部署与实验:快速验证大模型微调策略,无需昂贵的多 GPU 服务器。

🚀 关键技术解析

📌 GPU 内存占用情况(基于 OPT 模型)

模型参数量 1.3B 2.7B 6.7B 13B 30B 66B 175B

显存需求(GB) 3.75 4.14 4.99 6.18 8.86 12.07 18.04

📌 动态离载(Dynamic Offloading)

• 计算-通信并行优化,确保 GPU 计算与数据传输高效协同。

• 自动分配计算任务,避免不必要的显存占用。

📌 兼容 Hugging Face Transformers

• 支持 Hugging Face 生态系统,可直接用于 OPT、GPT、BLOOM 等主流大模型的微调。

• 提供 ZOTrainer / ZOSFTTrainer 训练器,适用于不同微调任务。

📌 MeZO-SGD 优化器

• 采用 零阶优化(Zeroth-Order Optimization),减少梯度计算压力,提升训练效率。

上篇:

AIaW - 全功能、轻量级、可扩展的AI对话客户端

下篇:

Oliva - 高效的商品检索能力,支持 语音交互

1 fonoster - 构建 AI 电话客服 2 FlyCut Caption 是一个基于 React 的智能视频字幕编辑组件 3 Pipet:为黑客而生的多功能数据抓取工具 4 Kottster:即开即用的 Node.js 后台管理面板 5 Magic平台作为一个开源的一体化AI生产力平台 6 Stand-In - 身份保持型视频生成框架 7 sparka - 多模型 AI 聊天平台 8 WriteHERE - 人工智能写作项目 9 DevDocs - 免费开源文档处理平台 10 AI Agent?Google 出品的 智能体 11 OmAgent - 为快速原型和生产构建多模态语言代理 12 OpenAvatarChat - 实时交互数字人系统